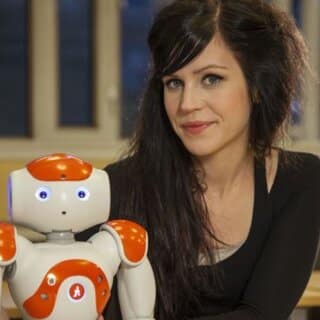

Robotar i klassrummet behöver bli smartare

Född: 1986

Bor i Horred

Disputerade 2017-09-15

vid Göteborgs universitet

Child–Robot Interaction in Education

Mänskliga robotar måste bli smartare för att till fullo fungera som resurs i klassrummet. Men robotar i skolan innebär också stora etiska problem kring datalagring och barnens integritet, konstaterar Sofia Serholt som forskat i ämnet.

Varför blev du intresserad av ämnet?

– Jag har en bakgrund som lärare i engelska och IT. Jag visste egentligen inget alls om robotar när jag började forska om robotar i skolan men kände att jag ville vara med och påverka utvecklingen inom området.

Vad handlar avhandlingen om?

– Om hur elever interagerar med pedagogiska robotar och vilka konsekvenser det innebär när sådana tar plats i skolan utifrån både ett praktiskt och etiskt perspektiv. Inledningsvis gjorde jag en studie för att mäta hur barnen reagerar på instruktioner som ges av antingen en robot eller en lärare. Den robot som används i studien ser ut som en docka, har empatiska förmågor, säger ”hej, hur mår du idag”, och liknande och kan förutom att kommunicera verbalt även läsa av vissa ansiktsuttryck. Vad den däremot inte förstår är gester.

– För att undersöka hur roboten fungerar i klassrummet placerades den under drygt en termin i ett rum i anslutning till klassrummet. I studien fungerade roboten som ett slags lärarassistent där eleverna en och en tillsammans med roboten skulle lösa ett antal digitala uppgifter i ämnet geografi. Sedan spelade även två elever åt gången ett spel med roboten som gick ut på att tillsammans utveckla ett hållbart samhälle. I det fallet var roboten mer av en samarbetspartner.

Vilka är de viktigaste resultaten?

– Resultaten i den första studien visar att barnen är villiga att lyssna på roboten, men att de till skillnad från samspelet med läraren inte söker hjälp från den när de inte förstår. I klassrummet interagerade eleverna socialt med roboten trots att de visste att roboten inte förstod. Elevernas sociala interaktion avtog dock med tiden.

– Men det uppstår också situationer där samspelet med roboten inte fungerar. Ofta beror detta på robotens oförmåga att engagera barnet från början, exempelvis i uppgifterna i geografi. Sedan fortsätter roboten sina instruktioner trots att barnet inte är med på noterna och här uppstår förstås förvirring. Roboten kan ibland också ge fel instruktioner eller säga irrelevanta saker. En del äldre elever förmår genomskåda roboten, inse att den helt enkelt säger fel. Men alla elever gör ju inte det, särskilt inte de yngre.

– Även i speluppgiften där eleverna arbetar två och två tillsammans med roboten, uppstår problem. Exempelvis när elever diskuterar vilken strategi som är smartast i syfte att komma så långt som möjligt i spelet. Den här diskussionen förstår inte roboten, vars agerande istället kan leda till att spelet tar slut. I de här situationerna blir eleverna arga, vissa hånar roboten eller försöker fatta beslut åt den.

– Sammantaget visar resultaten att robotar måste bli mycket smartare, framför allt mer socialt kompetenta, för att fullt ut fungera som resurs i skolan. Men med detta uppstår också ett stort etiskt problem, främst kring lagring av information och hur barnens integritet ska säkras. En annan aspekt är hur robotar med begränsade sociala kompetenser påverkar barn känslomässigt i långa loppet. Kort sagt, det finns en lång rad etiska dilemman som måste beaktas vid utveckling av robotar.

Vad överraskade dig?

– Jag trodde att barnen i högre grad skulle genomskåda roboten, inte ta den på så stort allvar som de faktiskt gjorde.

Vem har nytta av dina resultat?

– Delvis robotforskningen men också skolans aktörer där jag hoppas att resultaten kan bidra till att sprida perspektiv och kunskap kring robotar i skolan.

Relaterade länkar

Svenska som andraspråk

Åk F–Vux

Åk F–Vux

Tematiska projekt i fritidshemmet

Åk F–6

Åk F–6